Des questions de sécurité se posent alors que de plus en plus d'individus utilisent le ChatGPT, développé par OpenAI. Il s'agit de converser avec des réponses provenant d'une plateforme basée sur l'IA.

Cet article examine la sécurité de ChatGPT, y compris son objectif et ses sources d'information. Il explique également pourquoi certaines écoles l'ont interdit et présente les techniques de gestion des risques d'OpenAI. Enfin, la valeur de la supervision et de l'intervention humaines sera examinée.

Nous proposons également une suggestion bonus pour protéger les enfants des applications à risque en utilisant FamiSafe. Sans plus attendre, plongeons dans le vif du sujet !

ChatGPT Guide d'utilisation en toute sécurité

Partie 1. Quel est l'objectif de ChatGPT ?

OpenAI a développé le modèle de langage de l'IA conversationnelle connu sous le nom de ChatGPT. Il analyse les données textuelles à l'aide de techniques d'apprentissage automatique afin de découvrir des modèles d'utilisation de la langue. Les principales raisons d'utiliser ce logiciel sont les suivantes :

1. L'IA conversationnelle

ChatGPT peut interagir avec des personnes et fournir des réponses en langage naturel à des questions. Cela en fait un outil puissant pour l'éducation en ligne et les applications d'assistance à la clientèle. Ainsi que pour d'autres personnes qui ont besoin d'une interaction en langage naturel.

2. Une variété de sujets

Il tire ses données de formation de l'internet et peut accéder à une vaste base de connaissances sur divers sujets. Avec ChatGPT, les utilisateurs peuvent poser des questions sur n'importe quel sujet et obtenir une réponse en langage naturel.

3. Compléments de texte

Les utilisateurs peuvent créer des textes sur des sujets en utilisant ChatGPT pour générer des réponses en langage naturel. Cela a plusieurs applications, notamment l'aide à la rédaction et au développement de contenu.

4. L'efficacité

ChatGPT est plus efficace et plus abordable que les représentants humains du service clientèle. Les utilisateurs peuvent obtenir rapidement les informations qu'ils souhaitent. Il permet de gérer instantanément de nombreuses discussions et de générer des réponses instantanément.

Après avoir vérifié l'objectif du ChatGPT à utiliser, nous devons connaître les sources. Nous pouvons ainsi évaluer ses mesures de sécurité. Lire la suite pour connaître ses sources d'information !

Partie 2. D'où ChatGPT tire-t-il ses informations ?

ChatGPT tire ses informations d'un énorme ensemble de données textuelles connu sous le nom de Corpus. Ce corpus a été compilé à partir d'une variété de sources en ligne, y compris des livres, des essais, des sites web et d'autres travaux écrits.

Comment est utilisé Corpus ?

Le corpus est utilisé pour apprendre à ChatGPT à reconnaître des modèles linguistiques. Ils aident également à produire des réponses en langage naturel à des questions et à des messages-guides.

ChatGPT utilise des méthodes d'apprentissage profond tout au long de la phase de formation. Il s'agit donc d'examiner et de découvrir des modèles dans le texte saisi. Cela lui permet de comprendre le contexte. Comprendre le sens des mots et des phrases et produire des réponses pertinentes.

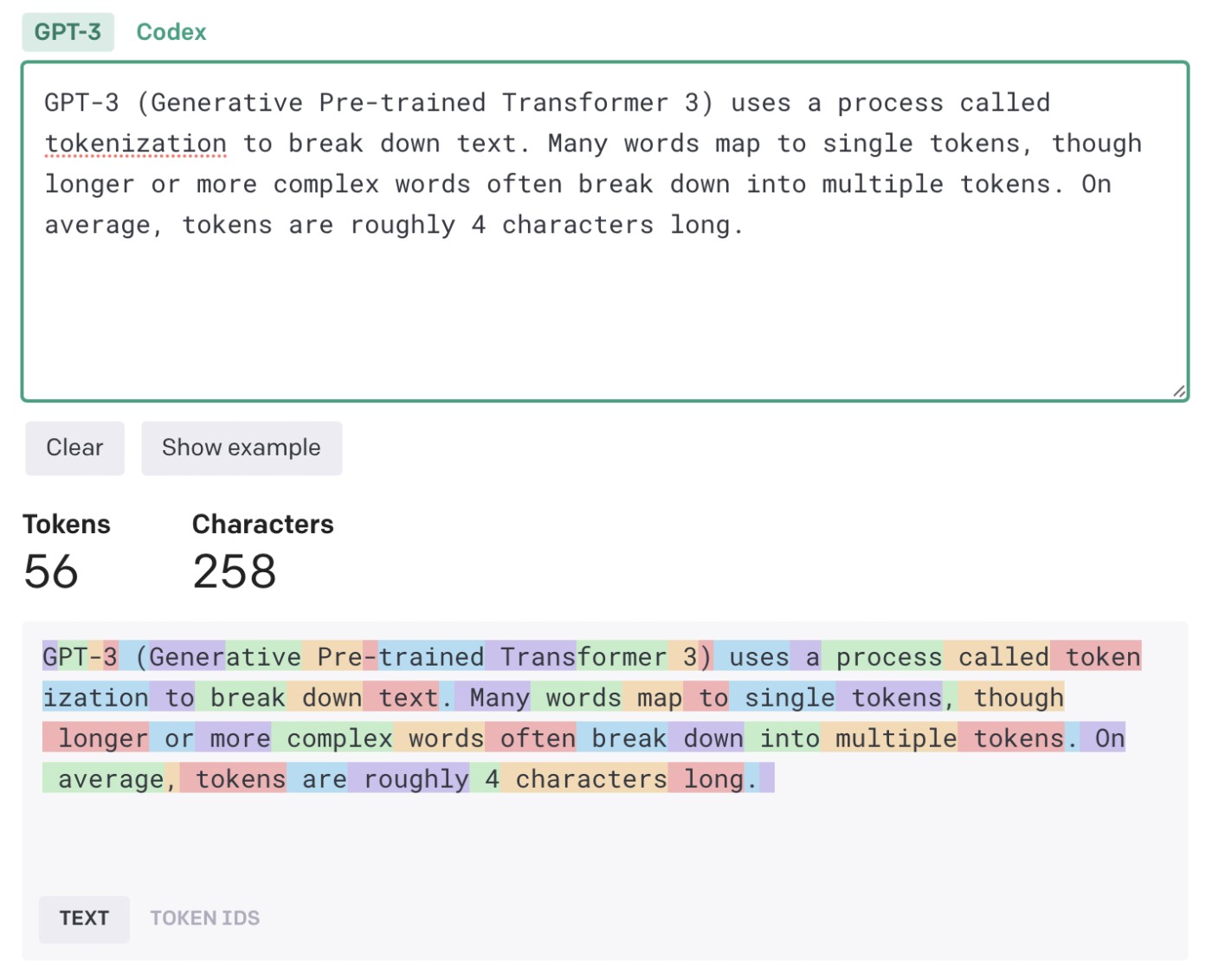

Que fait ChatGPT après avoir supprimé les doublons ?

Les données d'apprentissage sont prétraitées afin d'éliminer les doublons et les informations sans rapport. Les données restantes sont classées en jetons.

Les jetons sont des collections de mots ou de phrases. Grâce à eux, ChatGPT est entraîné à reconnaître des modèles entre les mots du langage naturel.

Note: ChatGPT recueille ses données à partir d'un vaste ensemble de textes obtenus sur l'internet. Il l'utilise ensuite pour améliorer ses capacités de traitement du langage naturel.

Par conséquent, ChatGPT peut comprendre une grande variété de sujets. Ils produisent également des réponses en langage naturel aux demandes et suggestions des utilisateurs.

Partie 3. Pourquoi le ChatGPT a-t-il été interdit dans certaines écoles ?

Plusieurs écoles ont interdit l'utilisation de ChatGPT et d'autres chatbots alimentés par l'IA pour des raisons de sécurité. L'utilisation de ChatGPT a été interdite dans les écoles et les districts scolaires aux États-Unis, en Australie et en Inde.

Voici quelques justifications :

1. Interactions inappropriées et cyberintimidation

Les élèves partagent des informations personnelles ou ont des interactions inappropriées par le biais de ChatGPT. Il pourrait en résulter une cyberintimidation ou d'autres situations dangereuses, ce qui est préoccupant.

Les écoles ont le devoir de protéger les enfants contre ce type de menaces. Et l'utilisation de ChatGPT peut être considérée comme un risque pour cette responsabilité.

2. La tricherie est possible

Des inquiétudes ont également été exprimées quant au fait que le ChatGPT permette de tricher lors d'examens ou de devoirs. Les élèves peuvent utiliser ChatGPT pour terminer leurs devoirs ou découvrir des solutions. Puisqu'il peut produire des réponses en langage naturel aux demandes.

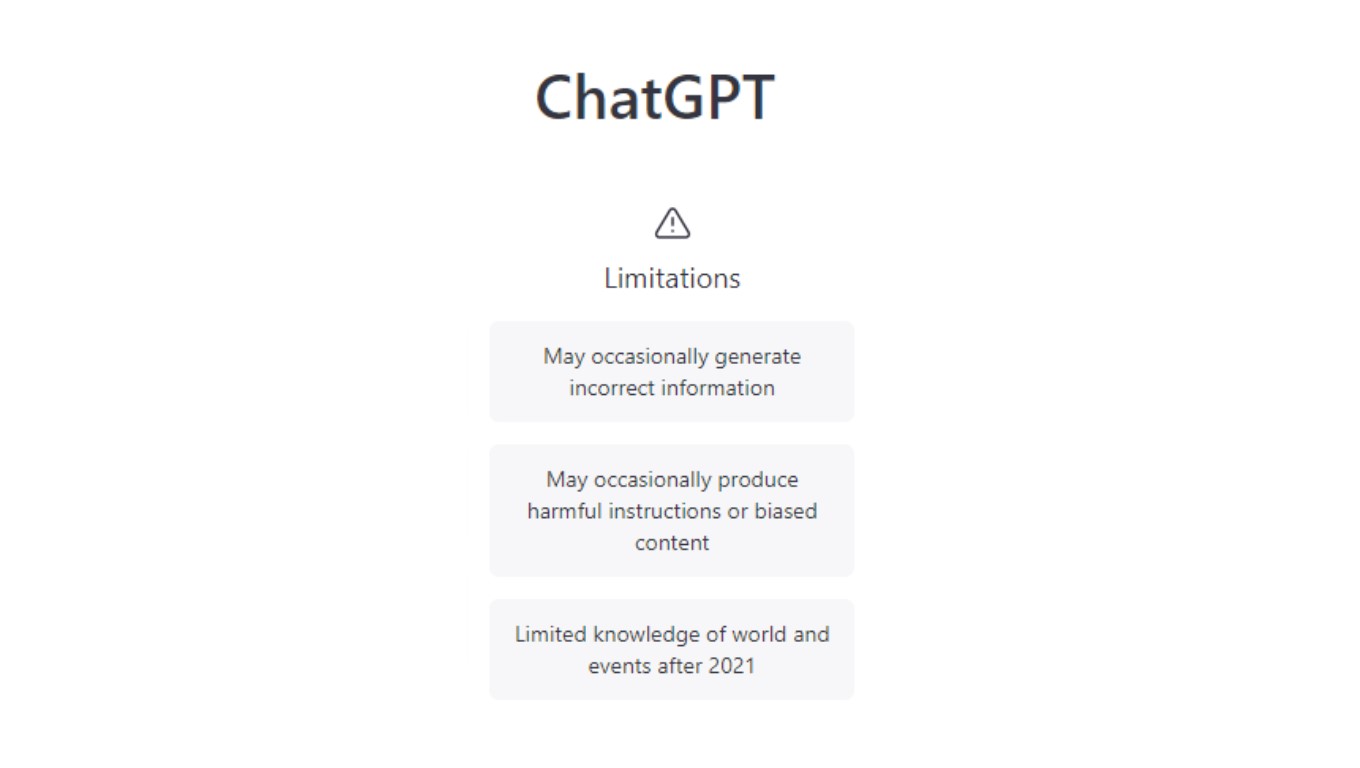

3. Possibilité d'informations trompeuses ou incorrectes

Un autre problème est la possibilité pour ChatGPT de proposer des informations biaisées ou fausses. Comme il y a une formation sur un ensemble de données textuelles assez important. ChatGPT court toujours le risque de produire des réponses incorrectes ou inadaptées à une salle de classe.

Note: Les élèves pourraient ainsi recevoir de fausses informations, ce qui nuirait à leur éducation.

4. Considérations juridiques et morales

Pour autoriser l'utilisation du ChatGPT, les écoles doivent également prendre en compte les questions juridiques et éthiques. Il s'agit notamment des lois régissant la confidentialité des données et de l'obligation d'offrir à tous les élèves un environnement d'apprentissage sûr.

Note: Le choix d'interdire le ChatGPT dans les écoles est difficile. Parce qu'elle nécessite une analyse sérieuse de la sécurité des étudiants et des préoccupations juridiques.

Les chatbots alimentés par l'IA ont le potentiel d'être des outils d'enseignement utiles. Les écoles doivent donc mettre en balance leurs avantages potentiels et les menaces éventuelles. Voilà ce qu'ils peuvent représenter pour les enfants.

Les parents veulent surveiller leurs enfants pour des raisons de protection de la vie privée ou pour prévenir la cyberintimidation. Dans ce cas, ils doivent utiliser le logiciel indiqué ci-dessous !

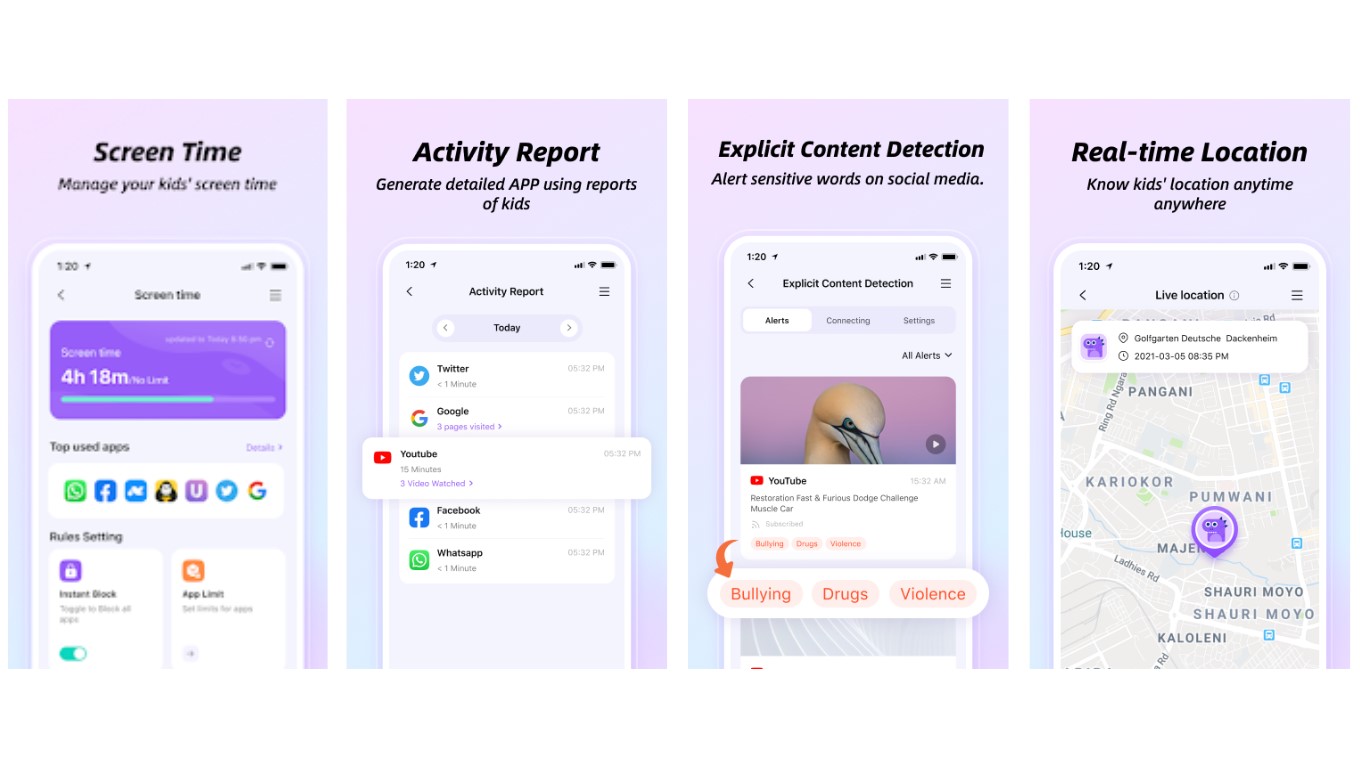

Partie 4. Règles de sécurité pour les systèmes d'IA FamiSafe

Les parents peuvent utiliser FamiSafe pour contrôler l'utilisation de ChatGPT par leurs enfants. Il empêche la copie de travaux et l'utilisation d'autres ressources en ligne. Le filtrage du contenu permet de restreindre l'accès à certains sites. Cela empêche les enfants de visiter des sites contenant des solutions.

Essayez-le gratuitement sur Google Play et App Store !

5 481 435 personnes se sont inscrites.

- Filtre Web et SafeSearch

- Limitation et programmation du temps d'écran

- Localisation et rapport de conduite

- Bloqueur d'applications et suivi de l'activité des applications

- Moniteur d'historique YouTube et bloqueur de vidéos

- Alertes sur les messages des médias sociaux et les images pornographiques

- Fonctionne sur Mac, Windows, Android, iOS, Kindle Fire, Chromebook

Grâce au blocage d'applications, les enfants peuvent éviter d'utiliser des applications de chatbot. Les parents peuvent repérer les problèmes et prendre les mesures qui s'imposent en utilisant les nombreuses informations disponibles sur les appareils de leurs enfants.

Principales caractéristiques de FamiSafe

Les principales caractéristiques de l'utilisation de FamiSafe sur les appareils pour enfants sont les suivantes :

- Permet aux parents de restreindre les applications sur le smartphone de leur enfant. Comme les chatbots, pour empêcher leurs enfants d'agir de manière inappropriée.

- Permet de filtrer le contenu des sites web afin d'empêcher l'accès à des sites web ou à des résultats de recherche douteux.

- Des alertes de géofencing peuvent être configurées pour avertir les parents lorsque leur enfant entre ou sort d'une certaine région.

- Les parents peuvent suivre les déplacements de leur enfant en temps réel.

- Empêchez les enfants d'utiliser leurs gadgets de manière excessive en limitant le temps passé devant l'écran.

- Les parents peuvent surveiller l'utilisation des applications et des appareils de leurs enfants, ainsi que leur historique de navigation.

- Établir un plan pour l'utilisation des appareils de leur enfant. Il s'agit notamment d'interdire certaines applications ou l'accès à l'internet pendant des heures déterminées.

- Trouver des mots ou des images potentiellement dangereux sur l'appareil d'un enfant.

En général, FamiSafe offre aux parents une gamme complète d'options pour les aider à protéger leurs enfants en ligne. Les parents peuvent dormir sur leurs deux oreilles, car ils disposent des outils nécessaires pour protéger leurs enfants. Ainsi, grâce aux fonctionnalités de FamiSafe.

Partie 5. Gestion des risques de sécurité par ChatGPT

ChatGPT dispose d'un certain nombre de techniques de gestion des risques pour garantir la sécurité et la sûreté de ses utilisateurs. Voici quelques moyens utilisés par ChatGPT pour contrôler les risques de sécurité :

1. Modération du contenu

Les réponses de ChatGPT sont présélectionnées et censurées pour le langage offensant et d'autres éléments, tels que les jurons. Cela permet d'empêcher les gens d'avoir des discussions hasardeuses ou inappropriées avec le chatbot.

2. Suivi des utilisateurs

De plus, ChatGPT suit les actions des utilisateurs et les alerte en cas de comportement douteux. Par exemple, les tentatives d'échange d'informations privées ou les discussions inappropriées. ChatGPT peut arrêter le chat ou demander à un modérateur humain d'intervenir si une telle conduite est constatée.

3. Protection de la vie privée

ChatGPT ne recueille pas volontairement de données d'identification personnelle dans le cadre de sa conception de la protection de la vie privée des utilisateurs. Toutes les données des utilisateurs sont cryptées et stockées de manière sécurisée afin d'éviter tout accès indésirable ou toute fuite de données.

4. Mécanismes de sécurité robustes

ChatGPT utilise des procédures de sécurité solides pour se prémunir contre les accès non désirés et les tentatives de piratage. Ces méthodes comprennent le cryptage, les pare-feux et les audits de sécurité de routine pour trouver et corriger les éventuelles failles.

Avec l'aide de ChatGPT, les consommateurs peuvent interagir avec le chatbot. Alors qu'ils se trouvent sur une plateforme sécurisée capable de gérer les risques de sécurité.

Partie 6. Supervision et intervention humaine

Bien que ChatGPT ait mis en place plusieurs techniques de gestion des risques. Il s'agit de garantir la sécurité de l'utilisateur, la surveillance humaine et l'intervention sont toujours des éléments cruciaux du processus de sécurité. L'explication est la suivante :

Limites de l'intelligence artificielle (IA)

ChatGPT peut créer des réponses en langage naturel aux requêtes, mais il a encore des limites. Il peut avoir besoin de comprendre correctement le contexte d'une discussion. Parce qu'il pourrait en résulter des réponses inappropriées ou incorrectes.

Une surveillance humaine est nécessaire pour s'assurer que ChatGPT fournit aux utilisateurs des informations exactes.

Gestion d'un problème complexe

Les utilisateurs soulèvent parfois des questions complexes ou délicates qui nécessitent une intervention humaine. Un modérateur humain peut être amené à intervenir et à proposer des ressources ou de l'aide. Par exemple, si un utilisateur a des pensées suicidaires ou s'il est victime de harcèlement.

Gestion des erreurs et des exceptions

Malgré les techniques de gestion des risques, des exceptions ou des erreurs peuvent nécessiter une intervention humaine. Un modérateur humain peut aider à résoudre les problèmes techniques ou les plaintes. Cela résout les problèmes pour l'utilisateur.

Note: Pour résoudre ces problèmes, ChatGPT peut faire appel à l'IA et à la modération humaine. Cette combinaison offre la meilleure expérience à l'utilisateur.

En tant que modérateurs humains, ils peuvent offrir une aide et une intervention plus personnalisées en cas de besoin. Ainsi, les chatbots alimentés par l'IA peuvent effectuer des tâches quotidiennes et fournir des informations de base.

Conclusion

ChatGPT est un modèle linguistique solide. Il aide les étudiants à faire leurs devoirs et à acquérir des connaissances générales. Cependant, il est essentiel d'être conscient des dangers liés à l'utilisation d'un chatbot pour effectuer des tâches à domicile.

En surveillant le comportement en ligne de leurs enfants, les parents peuvent contribuer à réduire ces risques grâce à FamiSafe. Les parents peuvent utiliser cet outil pour permettre à leurs enfants d'accéder à un environnement internet sécurisé.

FemiSafe permet de filtrer les contenus, d'interdire des applications, de surveiller la localisation et de gérer le temps passé devant l'écran. N'oubliez pas que c'est à l'individu de prendre des décisions et d'utiliser ces outils de manière responsable.